Article body

正文

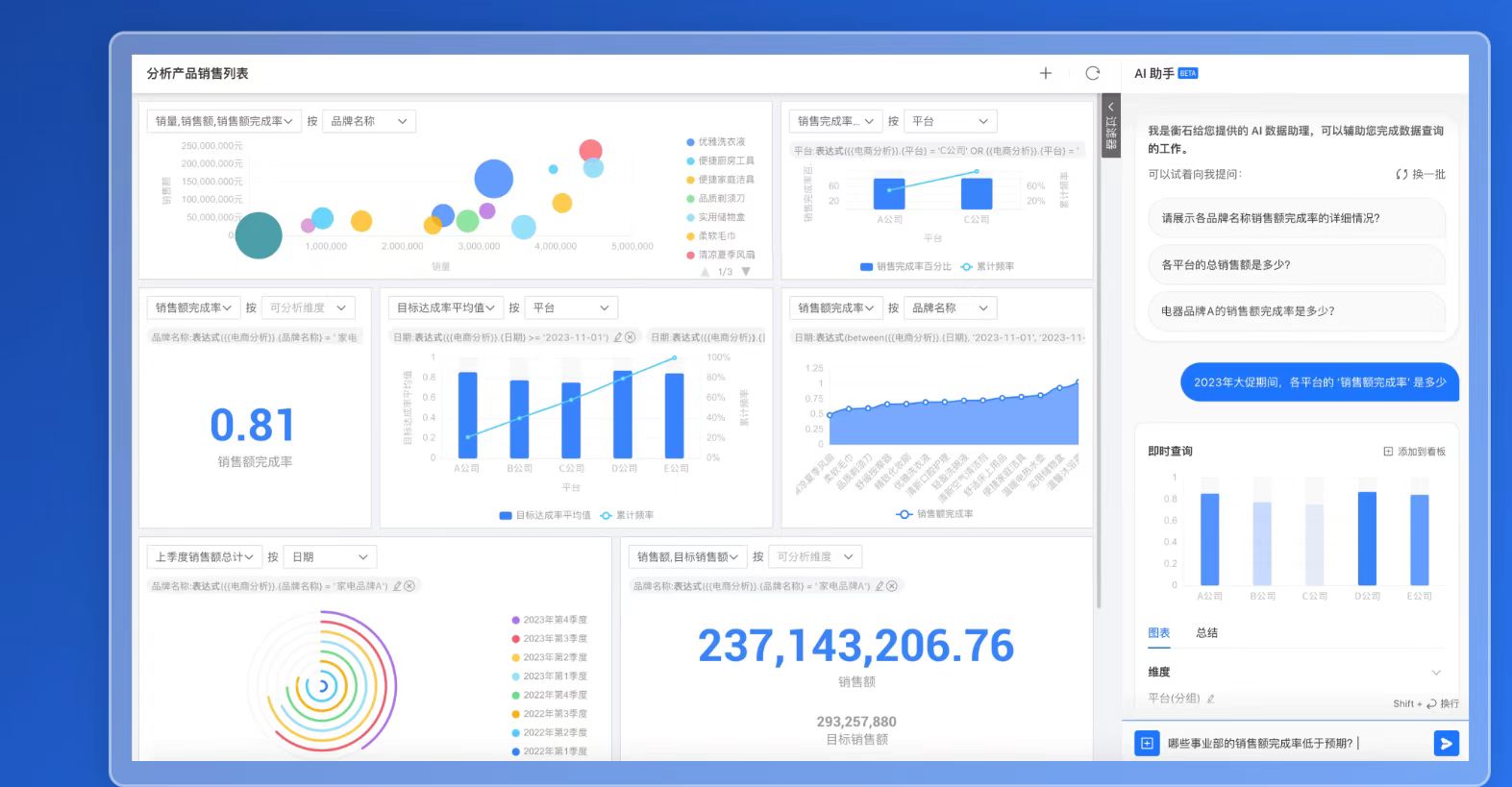

在企业级智能分析场景中,响应速度与智能深度之间存在天然的矛盾。大模型虽然理解能力强、推理深入,但延迟高、成本贵;小模型虽然速度快,但能力有限,难以处理复杂查询。衡石科技通过独创的混合模型策略,在二者之间找到了精妙的平衡点——用轻量级微调模型承担高频简单查询,用云端大模型处理低频复杂任务,在毫秒级响应的同时,保证了智能分析的深度和广度。

01 智能响应的“不可能三角”

在企业智能分析应用中,存在着一个“不可能三角”:低延迟、高智能、低成本三者难以兼得。

低延迟是企业级应用的刚性要求。研究表明,当系统响应时间超过2秒,用户的思维流就会被打断;超过5秒,用户就会产生焦虑感;超过10秒,大部分用户会选择放弃。在会议场景、即时决策场景中,对延迟的容忍度更低。

高智能是智能分析的核心价值。用户期望系统能够理解模糊的业务问题、处理复杂的多条件查询、进行深度的归因分析,甚至主动提供洞察。这通常需要大规模语言模型的支持。

低成本是企业规模化落地的现实约束。千亿参数大模型的每次调用成本可能高达数分钱,在企业每天数万次查询的场景下,成本将迅速失控。

传统的单一模型方案只能三者取其二:要么用大模型牺牲延迟和成本,要么用小模型牺牲智能。衡石的混合模型策略,正是要打破这个“不可能三角”。

02 混合模型架构:分工协同的智能体系

衡石的混合模型架构由三个核心组件构成:轻量级微调模型集群、云端大模型网关、智能路由引擎。

2.1 轻量级微调模型集群

轻量级模型是处理高频简单查询的主力军。衡石基于开源基座模型(如Qwen2.5-7B、Llama3-8B等),通过行业语料微调和量化压缩,构建了针对不同业务场景的专用小模型。

这些模型的特点:

参数量小:7B-14B参数,仅为千亿大模型的1/10甚至更少

推理速度快:在单张GPU上即可运行,首 token 延迟低于100ms

领域专注:针对特定行业(零售、金融、制造)或特定任务(意图识别、SQL生成)微调

可本地部署:支持私有化部署,数据不出域,满足安全合规要求

2.2 云端大模型网关

对于轻量级模型无法处理的复杂查询,衡石通过统一的网关接入云端大模型(如GPT-4、Claude等)。网关层负责请求转发、结果缓存、成本控制和异常重试。

云端大模型承担的任务包括:

复杂语义理解:涉及多轮对话、模糊意图、隐含假设的深度解析

复杂推理任务:需要多步骤逻辑链、外部知识辅助的分析

新场景探索:轻量级模型尚未充分训练的冷门业务场景

2.3 智能路由引擎

路由引擎是混合架构的“大脑”,负责在用户请求到达时,毫秒级判断应该由哪类模型处理。路由决策基于多维度的实时评估:

意图复杂度评分:通过一个轻量级的意图分类器(通常为BERT-base规模),快速识别查询的类型(简单查询、对比分析、归因分析、预测分析等)和复杂度。简单查询(如“昨天销售额多少”)直接路由至轻量级模型;复杂查询(如“为什么华东区销售额下降同时客流量上升”)可能需要大模型介入。

置信度评估:轻量级模型在生成答案时,同时输出一个置信度分数。当置信度低于阈值(如0.85)时,系统自动触发“二次确认”或转交大模型处理。

领域匹配度:如果查询涉及轻量级模型未充分训练的领域(如某企业特有的业务规则),路由引擎会将请求导向具备该领域知识的大模型。

成本与负载感知:路由引擎还实时监控系统负载和预算消耗,在高峰期优先使用轻量级模型,在低谷期可以适当放宽对大模型的使用。

03 轻量级模型的“炼成”:微调、蒸馏与量化

要让轻量级模型在特定领域达到接近大模型的准确率,需要一系列精密的优化技术。

3.1 行业语料微调

衡石积累了海量的企业数据分析对话数据,涵盖零售、金融、制造等20多个行业。这些数据包括:

真实用户查询及其标准化后的意图标签

专家标注的“问题-SQL-答案”三元组

多轮对话历史及对应的分析路径

基于这些高质量语料,衡石对基座模型进行监督微调,使模型掌握特定行业的术语、指标含义和分析范式。例如,在零售领域,模型需要理解“GMV”“客单价”“复购率”“同店销售”等概念及其计算逻辑。

3.2 知识蒸馏

知识蒸馏是将大模型的“智慧”迁移到小模型的关键技术。衡石采用“教师-学生”架构:

教师模型:云端大模型(如GPT-4)对大量查询生成高质量的分析过程和答案

学生模型:轻量级模型学习模仿教师模型的输出

通过蒸馏,轻量级模型能够复现大模型80%-90%的分析质量,而推理成本仅为后者的1/50。在某金融风控场景的测试中,蒸馏后的7B模型在意图识别准确率上达到96.3%,与GPT-4的97.1%相差无几,但延迟从2.1秒降至120毫秒。

3.3 量化与剪枝

为进一步提升推理速度,衡石对轻量级模型进行4-bit量化和结构化剪枝,将模型体积压缩60%以上,推理速度提升3-5倍,而精度损失控制在1%以内。量化后的模型可以在主流CPU上实时运行,无需昂贵的GPU。

04 智能路由:毫秒级的决策艺术

路由引擎的决策必须在几十毫秒内完成,否则就会抵消轻量级模型的优势。衡石设计了一套高效的路由机制:

4.1 两阶段路由

第一阶段:快速分类。采用一个极轻量级的FastText或小型BERT模型(参数量<100M),在10ms内完成意图的初步分类和复杂度打分。这个阶段可以过滤掉70%以上的简单查询,直接路由至轻量级模型。

第二阶段:深度评估。对于第一阶段判定为“可能复杂”的查询,路由引擎会调用轻量级模型进行试推理,并评估其置信度。如果置信度足够高,直接返回结果;如果置信度低,则转交大模型处理。

4.2 缓存机制

对于重复出现的查询,路由引擎会缓存轻量级模型的输出结果。当相同或相似的查询再次到达时,直接命中缓存,实现个位数毫秒的响应。衡石采用语义缓存技术,即使查询表述略有不同(如“上周销售额”和“过去7天销售额”),也能通过向量相似度匹配缓存。

4.3 动态阈值调整

路由阈值不是静态的,而是根据系统负载和业务场景动态调整。在业务高峰期,提高置信度阈值,让更多查询由轻量级模型处理;在低谷期,适当降低阈值,让大模型处理更多复杂查询,同时利用这些查询的数据持续优化轻量级模型。

05 性能实测:毫秒级响应的真实表现

在某大型零售客户的真实环境中,衡石混合模型架构展现了卓越的性能:

查询分布:

简单查询(单指标、单维度、无复杂计算):占比65%,平均响应时间120ms

中度查询(多指标关联、简单对比):占比25%,平均响应时间380ms

复杂查询(多步骤推理、归因分析):占比10%,平均响应时间2.8秒(含大模型调用)

系统级指标:

P95响应时间:650ms(95%的查询在650ms内完成)

大模型调用率:8.7%(远低于未使用混合策略时的100%)

成本节省:相比全量使用大模型,月度成本降低92%

更重要的是,用户体验显著提升。业务人员表示,系统响应“几乎没有等待感”,可以像与人对话一样自然地连续追问,思维不会被技术延迟打断。

06 应用场景:混合模型的落地实践

6.1 金融行业的实时风控

某股份制银行在信用卡反欺诈场景中引入混合模型策略。当客户交易触发风控规则时,系统需要实时判断交易风险并决定是否拦截。

轻量级模型处理常规模式识别,如“凌晨大额交易”“异地突发交易”,在50ms内给出风险评分

云端大模型仅在遇到复杂模式时调用,如“交易行为与客户历史画像偏离但无明确规则匹配”,进行深度推理

上线后,欺诈交易拦截率提升35%,而误报率下降22%,单笔交易风控耗时控制在150ms以内,完全不影响用户体验。

6.2 零售行业的实时促销决策

某连锁零售企业在促销活动期间,需要根据实时销售数据动态调整促销策略。

轻量级模型每分钟处理数万次销售数据查询,实时计算各门店、各品类的ROI,并推荐最优资源分配

云端大模型每小时进行一次全局复盘,分析促销活动的整体效果,识别新的优化机会

活动期间,促销资源利用效率提升40%,GMV同比增长28%。

6.3 制造行业的设备预测维护

某制造企业在生产线上部署传感器,实时监控设备运行状态。

轻量级模型实时分析传感器数据,识别异常模式,在100ms内发出预警

云端大模型每日分析历史数据,优化预警阈值和预测模型

部署后,设备意外停机时间减少53%,维护成本降低31%。

07 未来演进:自适应混合智能

混合模型策略的下一阶段,是构建自适应混合智能体系——系统能够根据用户行为、业务场景、系统负载动态调整模型组合,实现资源的最优配置。

持续学习闭环:轻量级模型将利用大模型处理过的复杂查询数据进行增量学习,不断扩展能力边界。随着时间推移,越来越多原本需要大模型的查询可以被轻量级模型接管,系统整体成本持续下降,响应速度持续提升。

多模态混合:未来的混合模型将不仅限于文本,还会集成图像识别、语音交互等多模态能力,构建更全面的智能体验。

边缘-云协同:轻量级模型将下沉到边缘节点,在离用户最近的地方提供服务;云端大模型作为能力中枢,处理边缘无法应对的复杂任务。这种边缘-云协同架构,将延迟进一步压缩到20ms以内。

当企业智能分析能够在毫秒级响应的同时,保持大模型级别的智能深度,一个全新的可能性正在打开:数据分析不再是需要刻意发起的“查询”,而是融入日常工作的“对话” 。业务人员可以在思考的同时与系统交互,决策可以在信息获取的瞬间完成,数据驱动的决策真正成为组织的本能反应。

衡石的混合模型策略,正是通往这一未来的技术基石。